对于残障或行动不便的人士来讲,可穿戴机器人给予了他们回归正常生活的可能性。近日学术期刊《Science Robotics》发表了一篇针对可穿戴机器人未来如何进一步扩展其应用范围的文章,探讨可穿戴机器人是否应该加入视觉系统这一方向进行了综合分析与评估。

▍探讨一:可穿戴机器人是否有实现更高级别辅助的可能性?

目前可穿戴机器人主要集中在上肢辅助设备与下肢外骨骼设备当中。这些设备通过提供握力和抓握稳定性,能够显著改善患者上肢的操作能力。对于下肢来讲,外骨骼机器人能够优化步态模式,减少能量消耗,使得行走更为自然和省力。这些可穿戴机器人的使用为残障人士回归正常生活提供了不少便利。

然而,要实现更复杂的任务和更高级别的辅助,仅仅依靠基本的机械设计、人体接口和用户肢体感应是不够的。研究人员观察,实现更进一步的高级辅助需要进一步推断用户的意图,以便系统能够做出更加精确和及时的反应。

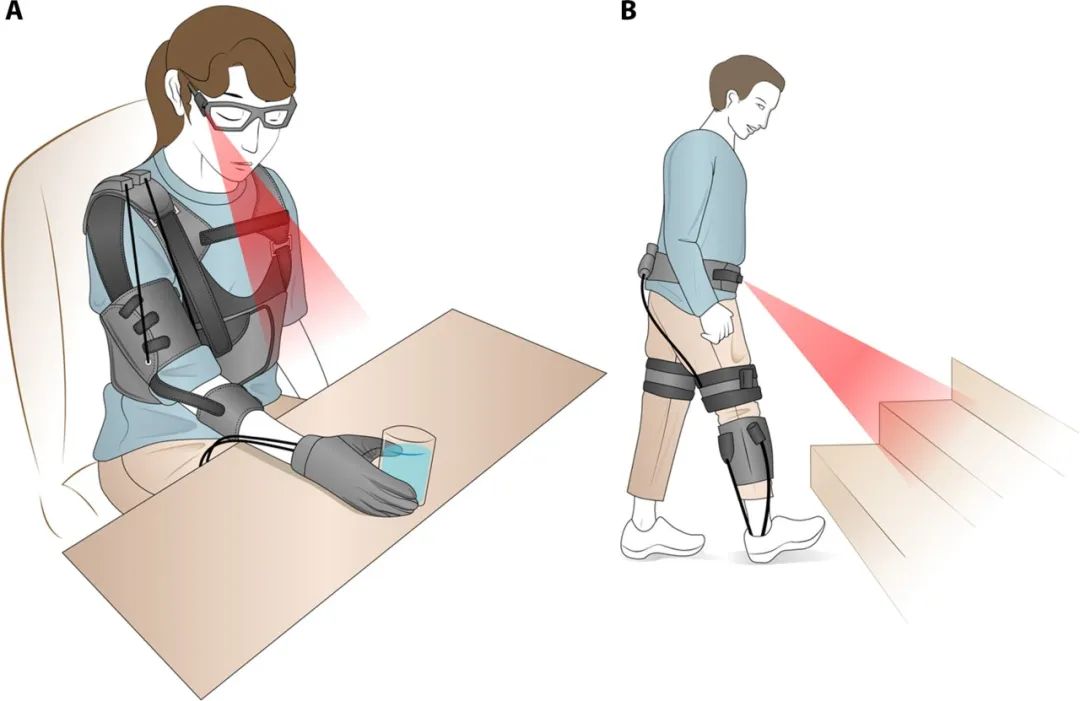

例如,辅助手套需要理解用户想要执行的任务,并据此调整抓握类型和手指跨度;对于腿部外骨骼或假肢,系统则需要检测到用户计划进行的动作,如爬楼梯或穿越湿滑路面,以提前调整关节扭矩,确保稳定性和安全性。

▍探讨二:如何精准的判断患者意图的推断,技术难点又是什么?

目前,推断用户意图的主流方法包括基于惯性传感器和神经肌肉接口(如肌电图EMG)。惯性传感器通过获取用户的运动信息来预测其动作意图,而EMG则通过测量肌肉电信号来推断运动激活。

不过这种方法也存在一定的局限性,它们能够解码的信息量相对有限,往往只能执行一些简单的任务。此外,这些控制方式的感知往往比较复杂,且患者在使用过程中并不自然,这也直接提升了可穿戴机器人的弃戴率。

为了克服这些挑战,研究人员提出将可穿戴设备与用户的环境信息相结合。例如,通过机器学习技术,我们可以从EMG信号中检测出与不同动作过渡相关的肌肉活动变化,从而提高意图推断的准确性。此外,视觉系统在获取环境和任务上下文信息方面发挥着核心作用,它提供了关于用户及其周围环境的丰富、即时且可解释的信息。

▍探讨三:机器人视觉技术是否能够在可穿戴设备当中发挥更大作用?

视觉技术能够为我们提供关于人类行为的大量信息,这使得机器视觉技术成为提高可穿戴机器人性能的关键。通过结合有关环境和任务上下文的信息方面,可穿戴设备能够更加准确地推断用户的意图,并实现更高级别的辅助。

这一研究方向目前尚处前瞻领域,目前依然不少有待解决问题需要突破。例如,如何表示适当的用户意图、如何标记协助级别以及如何处理大量的训练数据等。

为此研究人员提出一种新的控制策略,这些策略将依赖于视觉输入并将视觉纳入环路以实现端到端控制。同时,还需要确保这些系统的安全性、隐私性和可接受性。例如,视觉遮挡可能导致意图分类错误,从而增加受伤的风险;而隐私问题则需要我们通过遵守相关法规(如HIPAA)来确保用户数据的安全。

▍结语与未来:

为了最大限度地扩大任务的范围和复杂性,可穿戴机器人需要整合来自患者身体以及环境方面的视觉信息,产生最终的控制策略,然而这种控制策略应该为半自主控制,同时为患者增加共享控制属性,这将增加患者使用的透明度和可接受程度。基于事件的摄像头使新的嵌入式视觉应用能够解决基于帧的摄像头带宽-延迟权衡问题,这对于需要高更新率和低带宽的可穿戴机器人至关重要。