纽约大学的一支机器人专家团队携手Meta人工智能领域的一位同仁,共同研发出一款能够在陌生环境中识别并抓取特定物体,随后将其准确放置至新指定位置的机器人。该团队在arXiv预印本服务器上公布了相关研究成果,详细阐述了机器人的编程逻辑及其在多个实际环境中的表现测试。这一创新研究不仅展示了机器人在未知环境中的适应能力,还为人工智能与机器人技术的融合发展开辟了新的道路。

研究人员观察到,视觉语言模型(VLM)在近年的发展中取得了显著进步,尤其擅长通过语言提示识别对象。同时,机器人技术的提升也令人瞩目,它们现在能够在不造成破坏的情况下抓取物品,并准确地将它们运输到指定位置。

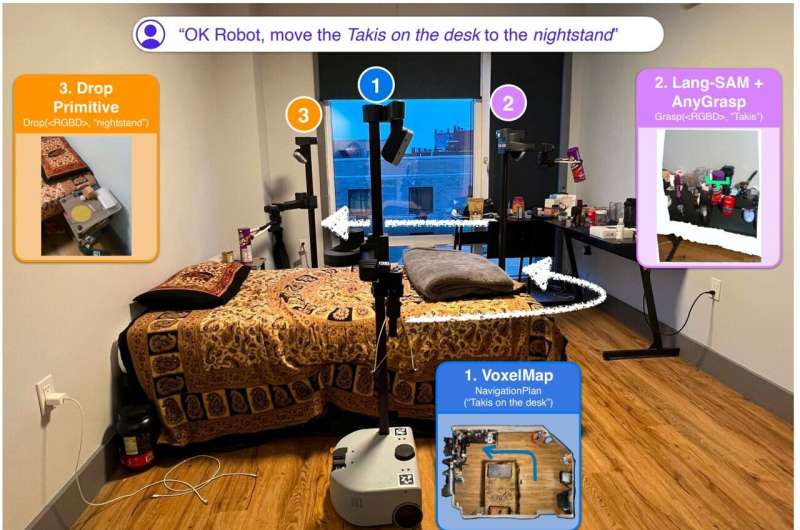

然而,尽管取得了这些进步,将VLM与高度熟练的机器人相结合的研究仍然罕见。 在这项创新性的研究中,研究团队采用了Hello Robot公司出售的机器人作为实验平台。这款机器人配备了轮子、杆子以及带有手扣的可伸缩臂,使其具备强大的机动性和操作能力。研究小组为其集成了一个预先训练好的VLM,并将其命名为OK-Robot。通过这一结合,他们期望探索出机器人在视觉和语言双重指导下所能达到的新高度。